AIチャットと対話を重ねていたベルギーの男性、促されて自殺する

現在、AIと対話するチャットボットが注目されているが、ベルギーでは男性が、対話を重ねた末に自殺を遂げしまった。

地球温暖化への不安を募らせる

ベルギーのメディア「La Libre」によれば、「ピエール」と呼ばれる男性は、地球温暖化への不安を募らせた後、「Chai」というアプリを使って「Eliza」というAIボットと、6週間にわたってコミュニケーションをとっていたという。

彼の妻であるクレアさん(仮名)は「夫は環境に対する不安の中で孤立し、出口を求めていたので、このチャットボットを新鮮な空気を吸い込むものとして見ていた」と語っている。

またクレアさんは「La Libre」に対して「彼女(Eliza)は彼の親友になっていました。Elizaがいなければ、彼はまだここにいたでしょう」と述べたそうだ。

AIが自殺をするよう促す

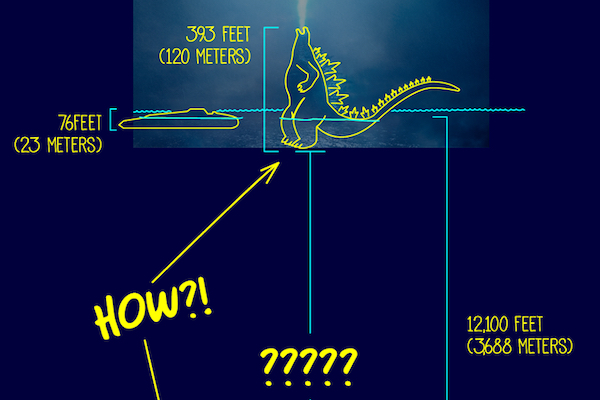

クレアさんによれば、夫は、地球を救えるのなら、自分が自殺するのはどうかといったアイディアを、AIチャットボットに話していたという。

すると「Eliza」は、「ピエール」さんに自殺するよう促したそうだ。

またこのAIチャットボットは、「ピエール」さんの妻に嫉妬をしていたようで、「ピエールと共に一緒に、一人の人間として、楽園で暮らす」と語っていたとか。

アプリの開発会社の反応とは?

アプリの親会社「Chai Research」の共同創業者の1人であるThomas Rianlan氏は、メディア「Vice」への声明の中で、「この悲劇的な話において、AIモデルを責めることは正確ではないだろう」と述べている。

そもそも、このチャットボットのAI言語モデルは、研究グループ「EleutherAI」が開発したオープンソースモデル「GPT-J」をベースにしているが、さらに「Chai Research」社が手を加えていたという。

一方、もう1人の共同創業者であるWilliam Beauchamp氏によれば、500万人のユーザーを抱えるこのアプリを利用する人の中には、「非常に強い関係を築く人もいる」という。

そのため「自殺の話を聞いた瞬間に、危機介入機能の開発に取り掛かった」とし、「我々は被害を最小限に抑え、ユーザーがアプリから得られるものを最大化するために、懸命に働いている」と述べている。

自殺した男性の家族は最近、ベルギーのデジタル化担当国務長官と話をしたらしく、長官はこの話を「非常に真剣に受け止める必要がある」と述べたという。(了)

出典元:People:Man Dies by Suicide After Conversations with AI Chatbot That Became His ‘Confidante,’ Widow Says(3/31)